OpenAi Dev Day, ecco tutto quello che c’è da sapere

Annunciati quattro strumenti per gli sviluppatori. Nessun nuovo chatbot.

3' di lettura

3' di lettura

OpenAI in occasione del suo evento dedicato agli sviluppatori ha annunciato alcuni nuovi tool studiati per per semplificare la creazione di app AI avanzate. Nessun nuovo LLM come invece ci si attendeva ma strumenti che aggiornano funzionalità esistenti. Quattro i tool presentati, andiamo in ordine. API Realtime consente di integrare esperienze multimodali a bassa latenza nelle app, con conversazioni speech-to-speech. Poi viene offerta una modalità fine-tuning di GPT-4o con immagini e testo. In pratica si aprono nuove possibilità per la ricerca visiva, il rilevamento di oggetti e l’analisi di immagini biomediche. Prompt Caching riduce costi e latenza del 50% per gli sviluppatori. E Model Distillation Suite che aiuta a creare modelli più piccoli ed efficienti, eguagliando le prestazioni di modelli più grandi a costi inferiori. Vediamo come funzionano.

Api Realtime per i servizi voce.

E’ pensato per la modalità vocale. In precedenza, per creare un’esperienza di assistente vocale simile, gli sviluppatori dovevano trascrivere l’audio con un modello di riconoscimento vocale automatico come Whisper , passare il testo a un modello di testo per l’inferenza o il ragionamento e quindi riprodurre l’output del modello utilizzando un testo in voce. Secondo OpenAi la Realtime API migliora questo processo trasmettendo direttamente input e output audio, consentendo esperienze di conversazione più naturali. Può anche gestire automaticamente le interruzioni, proprio come la modalità Advanced Voice in ChatGPT.

Modalità Fine Tuning per Gpt-4o

In pratica gli sviluppatori possono ottimizzare Gpt 4o con immagini e testo. Vediamo cosa cambia per le immagini. La messa a punto della visione segue un processo simile alla messa a punto del testo: gli sviluppatori possono preparare i loro set di dati di immagini in modo che seguano il formato corretto e quindi caricare quel set di dati sulla nostra piattaforma. Secondo OpenAi ora gli sviluppatori possono migliorare le prestazioni di GPT-4o per le attività visive con appena 100 immagini e ottenere prestazioni ancora più elevate con volumi maggiori di dati di testo e immagini.

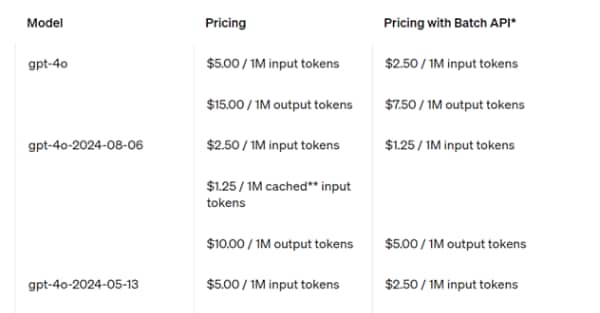

Prompt Caching, sconti automatici sulle domande

Si offrono sconti automatici sugli input che il modello ha visto di recente. Molti sviluppatori, si legge nel sito, usano ripetutamente lo stesso contesto su più chiamate API quando creano applicazioni AI, come quando apportano modifiche a una base di codice o hanno lunghe conversazioni multi-turn con un chatbot. Con Prompt Caching promettono di ridurre costi e latenza. Riutilizzando i token di input visti di recente, gli sviluppatori possono ottenere uno sconto del 50% e tempi di elaborazione dei prompt più rapidi.